| |

|

| 知识库 -> 科技 -> DeepSeek 2026年4 月30 日发布几小时后删除的视觉模型技术报告,透露出哪些信息? -> 正文阅读 |

|

|

[科技]DeepSeek 2026年4 月30 日发布几小时后删除的视觉模型技术报告,透露出哪些信息? |

| [收藏本文] 【下载本文】 |

|

2026年4月30日下午发布,23时左右删除 Github原链接: https://github.com/deepseek-ai/Thinking-w… |

|

模型昨天测了,见 |

|

|

如何评价 DeepSeek 刚刚上线的多模态「识图模式」?202 赞同 ・ 28 评论 回答 结果,DeepSeek又发新论文了,果然是放假之前必作妖,说好的中国人不卷中国人呢? |

|

|

这次论文介绍的是多模态大模型,提出了一个全新的推理框架,把空间标记(bounding box 与 point)内嵌进思维链,作为语言与图像之间的精确指针,让模型做到一边指点一边推理。 |

|

|

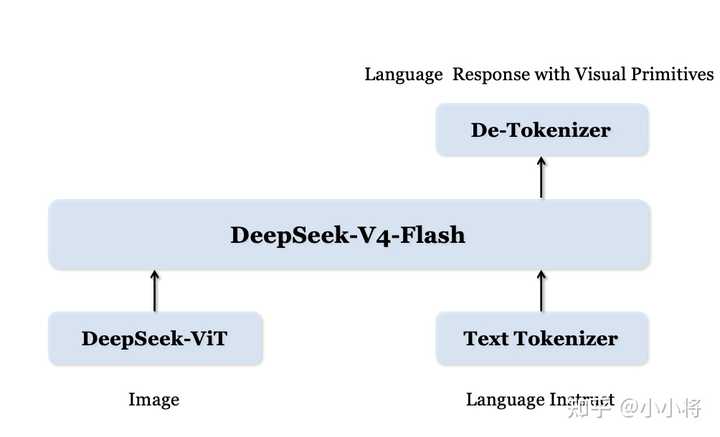

思路很正,就像人在走迷宫,或者清点密集物体时,会自然地用手指比划来降低认知负荷、保持逻辑上的一致性。 DeepSeek这篇论文,就是把人用手指,来抽象到思考时,有效地定位到具体事物的空间坐标上。 你会发现,DeepSeek在做多模态视觉这一块,真的高立意,没看过DeepSeek-OCR、DeepSeek-OCR2的朋友,可以去看一下。 而这一切都是为了解决Reference Gap(指代鸿沟)的问题,因为在复杂的视觉推理中,卡住模型的往往是不知道在在推理过程中到底指的是图里的哪一个东西。 比如让数一堆人、找某条曲线的终点、判断迷宫能不能走通,可能一开始看得没问题,但推理到后面就容易把对象搞混、漏掉、重复数,或者在空间关系上绕晕。 但是,其实我昨天在测试过程中,发现在复杂的空间逻辑推理上,回答的并不好,不知道怎么回事儿? 好了,接下来我们说论文细节, DeepSeek-VL的架构,还是经典的三段式,并不是原始多模态。 |

|

|

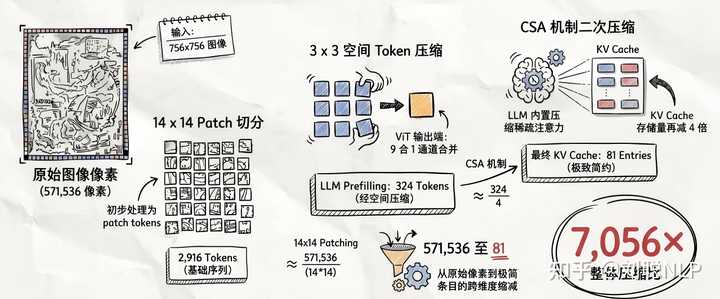

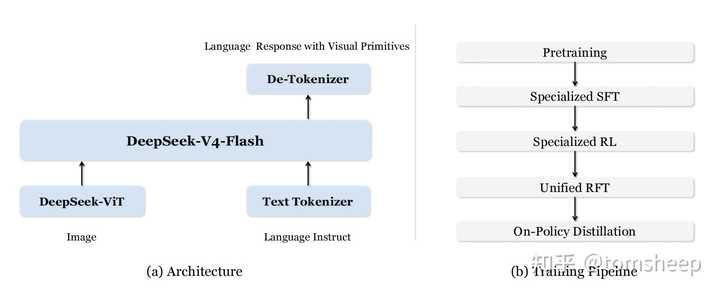

视觉编码器,采用零训练的内部DeepSeek-ViT,支持任意分辨率的输入。这里不同的是,借助CSA机制(见DeepSeek-V4),在最后对 KV cache 中的视觉 token 又进行4倍压缩,整体实现了7056×的压缩率。 |

|

|

语言模型部分,采用 DeepSeek-V4-Flash,总参数 284B、激活参 13B,跟我昨天猜的一致,就是Flash大小。 然后,前面说的把空间标记内嵌进思维链是如何做的呢? 对于框来说,就是把<|ref|>TARGET<|/ref|><|box|>[[x1,y1,x2,y2],[x3,y3, x4,y4]...]<|/box|>加入到思维链中,TARGET是对象的占位符 |

|

|

对于点来说,就是把<|point|>[[x1,y1],[x2,y2]...]<|/point|>替换成TARGET,加入到思维链中, |

|

|

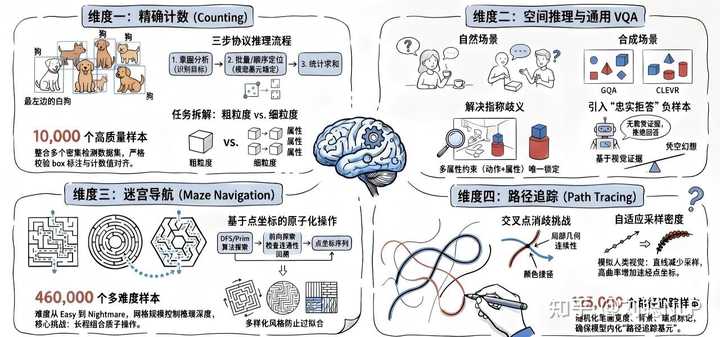

那么如何构造这类数据就变成了重点,这也是DeepSeek花了大篇幅讲的内容。 预训练部分数据主要涉及现有开源数据集和网络采集数据,预训练共计消耗 数T Tokens。 其中,网络财经数据一开始汇集得到 97984 个 box grounding 相关的数据源,然后经过两层流水线过滤。 基于语义的审核,去除无意义的机器编码与乱码(内部标签,比如0、1,无法自然语言释义)、去除无法泛化的私有实体(特定人称代号及ID,保留名人&公众人物)、去除含糊的缩写与主观性评价(工业ok、NG等标签,无视觉描述),保留下 43141 个数据集。视觉几何质量审核,去除严重漏标(存在多个标签实例,但漏标>50%),去除严重截断与偏移(边框没有包裹目标对象)、去除巨框(某个边框覆盖超过 90%的图像),保留下31701 个数据集 然后设计了一种基于类别的采样策略,对每个数据集中的每个类别,随机采样 1000 张与该类相关的图像,再对汇总结果执行全局去重,最终得到 超过 4000 万 高质量数据。 预训练是通过设计提示模板,来把框、点坐标加入数据中, 例如: 对于SFT数据,设计了4种任务,计数、空间推理与通用视觉问答、迷宫导航、路径追踪。 |

|

|

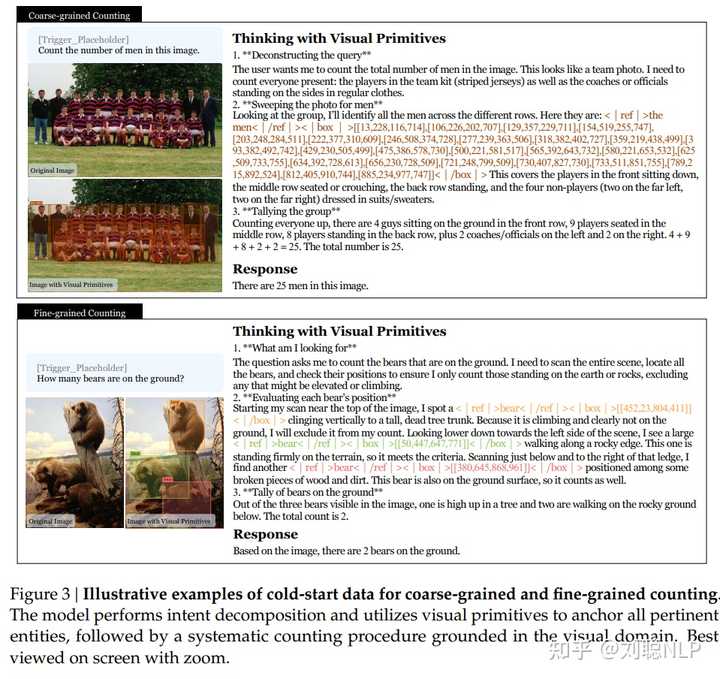

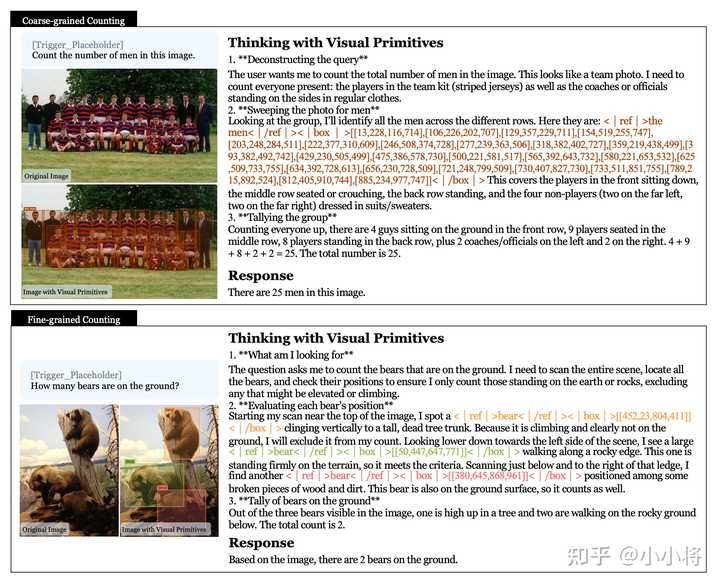

计数分为粗粒度计数(聚焦于通用类别的计数) 与 细粒度计数(要求按具体属性或空间约束对对象进行区分),共计1w条样本 。 粗粒度计数来源多个密集检测数据集,为了确保数据质量,基于避免对象密度过高、确保边界框足够大以便清晰辨认、保持 ground-truth 框标注有较高的召回率的三个准则执行过滤。对思考内容的生成遵循(1)意图分析,模型识别出目标类别;(2)批量定位,模型利用视觉单元同时定位所有候选对象;(3)统计求和,基于前面的视觉单元进行汇总;并进行严格数据校准 细粒度计数,通过流水线构建涉及问题生成、 思考内容合成,同时还构建了计数为 0 的负样本,以增强模型在对抗幻觉方面的鲁棒性。 |

|

|

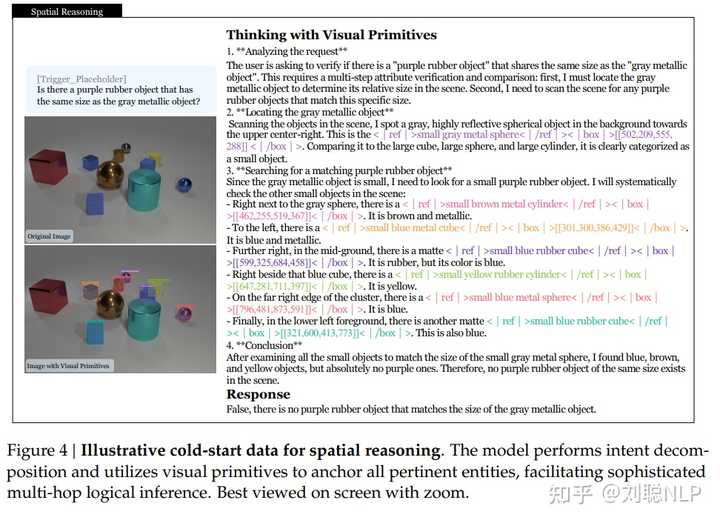

空间推理与通用视觉问答,核心心目的在于缓解纯语言描述带来的指称歧义和语义漂移问题,共 9000条样本。 自然场景数据主要来源于GQA的图像与场景图,通过提示 MLLM 设计围绕空间关系和对象交互的问题,并同步生成对应的思考内容。思考内容大体遵循意图分析、对象定位、关系推断的流程。为了减少拥挤场景中的歧义,模型会被要求选择更有区分度的对象,并结合多属性约束来唯一锁定目标。 合成场景数据基于 CLEVR 工具链构建,用于生成更复杂的多跳推理任务。CLEVR 支持控制对象密度,并提供问题生成和程序化执行轨迹,每一步推理都能映射到具体对象 ID。同时,还构造了一批负样本,其中被询问的对象或关系并不存在,用来训练模型基于视觉证据进行拒绝回答,而不是生成幻觉答案。 |

|

|

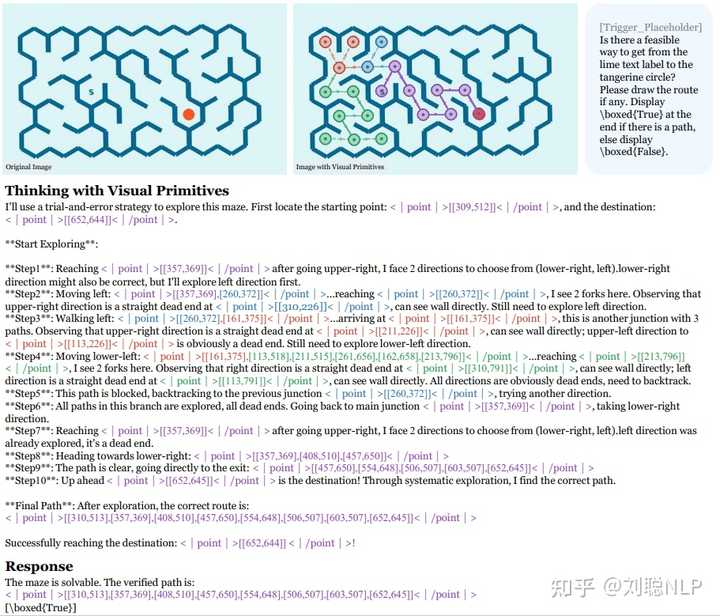

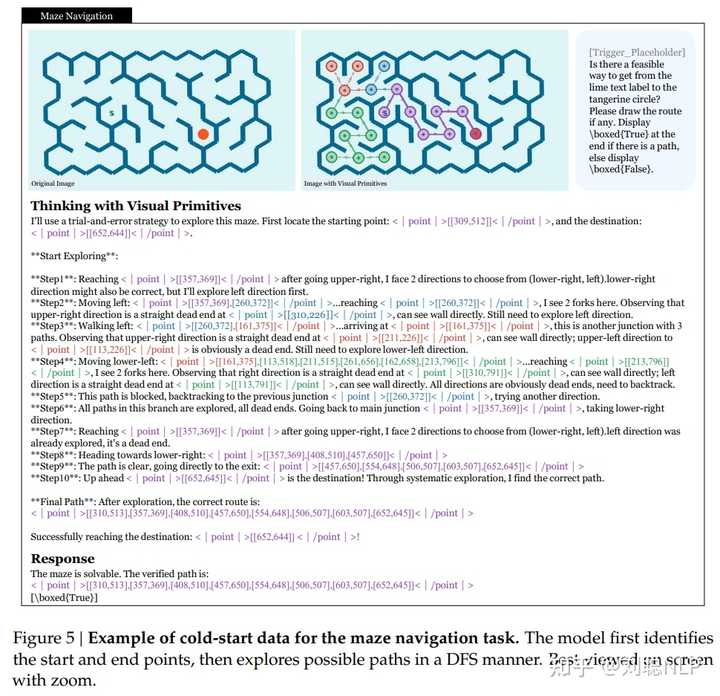

迷宫导航,本质上考察的是空间连通性和可达性,来训练模型的拓扑推理能力,共计 46w 条样本。 迷宫数据通过 DFS、Prim 和 Kruskal 算法合成,生成可解且具有一定挑战性的迷宫。拓扑结构上覆盖矩形网格、环形迷宫和六边形蜂窝迷宫三类。 思考内容合成上,设计了基于 DFS 的自然语言模板,用来描述前向探索和回溯过程。每一个步骤都会被点坐标锚定到图像中,对应检查墙体连通性、移动到相邻单元、从死胡同退回等操作。最终输出会判断迷宫是否可解,如果可解,还会给出经过验证的解路径。 |

|

|

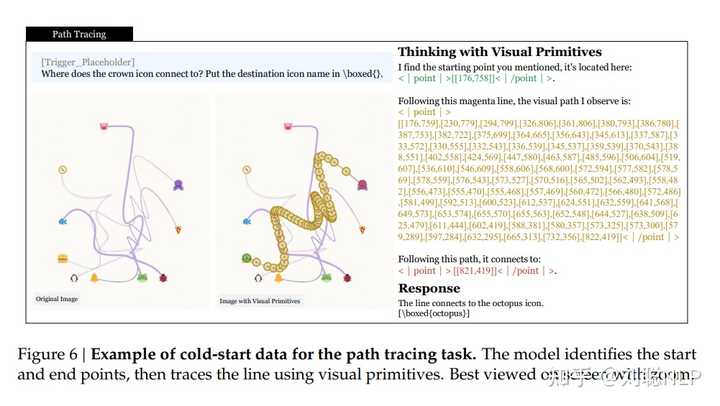

路径追踪,目标是在多条交织线条中沿着指定曲线前进,并判断最终到达的端点,共计 12.5w 条样本。 数据生成时,会避免端点与无关线条重叠或被穿越,并对不符合约束的样本进行丢弃和重新生成。为了避免模型走捷径,还引入了 uniform-style 模式,让所有线条共享相同颜色和笔画宽度,迫使模型不能依赖颜色匹配,而必须真正根据曲率连续性完成路径追踪。 思考内容合成上,把路径追踪过程表示为沿目标曲线采样得到的一串坐标。推理从定位被查询起点开始,随后沿曲线经过多个中间途经点,最后识别到达的终点。 |

|

|

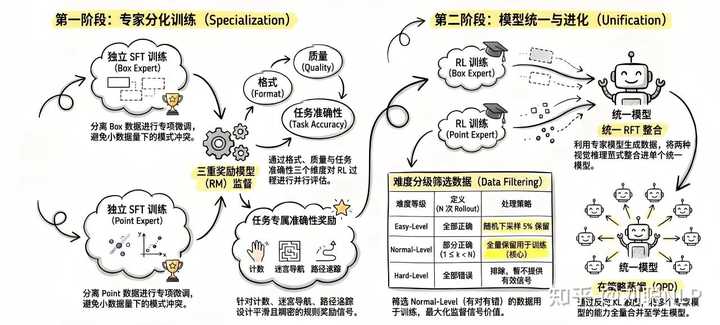

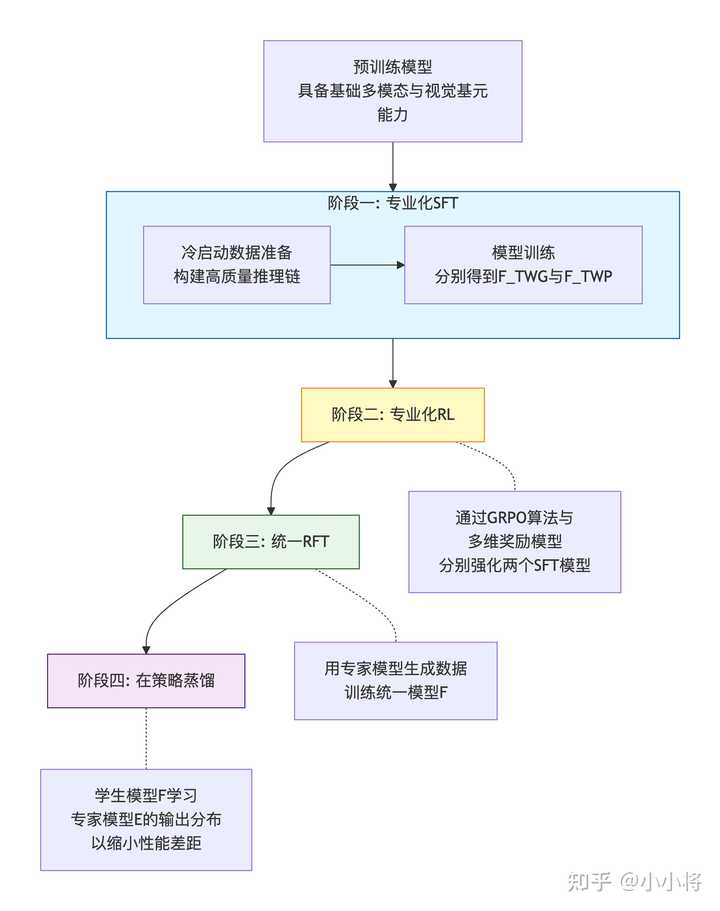

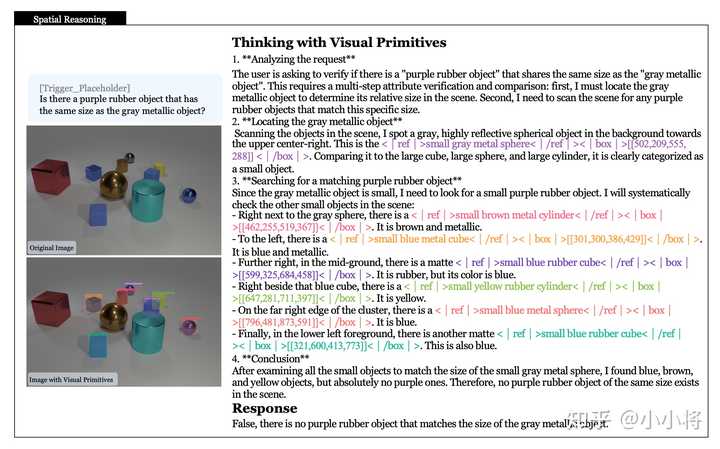

后训练,采用先训练专家、再进行合并的策略。 Specialized SFT 阶段,用70% 通用多模态与纯文本数据、30% 视觉单元思考数据组成,并分别针对 thinking with grounding 和 thinking with pointing 训练,得到 FTwG 与 FTwP 两个专家初始模型; Specialized RL 阶段,对两个模型分别使用 GRPO 做强化学习,由于冷启动数据中的视觉基元已经过严格校验,RL 阶段不再显式监督中间生成的 box 和 point,只需要图像、问题和最终答案,扩展性更强。奖励模型主要从格式、质量和准确性三个维度约束输出,其中格式和质量约束跨任务共享,准确性奖励则针对计数、VQA、迷宫导航、路径追踪分别设计,以提供更细粒度的训练信号。 统一强化微调阶段,把 thinking with grounding 和 thinking with pointing 两种视觉基元推理范式合并到一个模型里,用 ETwG 和 ETwP 两个专家模型对数据池进行 rollout,生成新的 RFT 数据,并沿用前面的难度分级方式筛选样本。从基座预训练模型重新开始训练一个增强版 SFT 模型,训练配置与冷启动 SFT 保持一致,只调整数据混合比例,最终得到统一模型。 在策略蒸馏阶段,采用 full-vocabulary logit distillation,也就是在全词表维度上进行 logit 蒸馏,让统一模型更充分地吸收两个专家模型的能力,把 grounding 专家和 pointing 专家的推理能力进一步压缩进单个统一模型中。 |

|

|

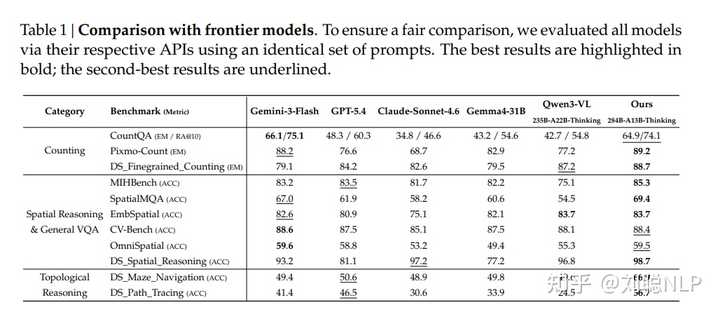

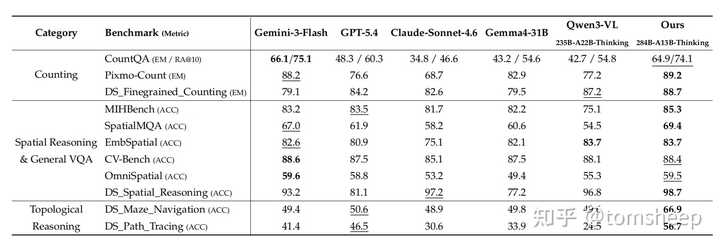

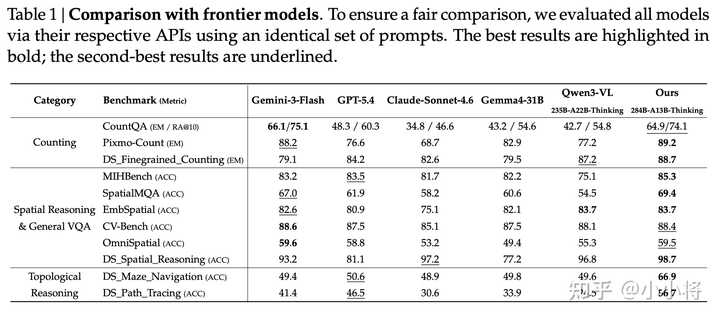

实验结果,当然是效果很不错, |

|

|

最后, DeepSeek这篇视觉思维链中增加box、point 思路真正呀, 解决视觉推理过程目标混淆、丢失, 让模型从看的更多,到看的更准上走, 只能说牛而逼之, 但不知道为啥,跟我昨天的实测,空间能力和逻辑推理能力差的比较多, 好奇,等模型全出来,重新再看看测测看。 PS:都看到这里,来个点赞、收藏、关注吧。 欢迎评论区多多讨论,说出你的想法。 送礼物 还没有人送礼物,鼓励一下作者吧 |

|

|

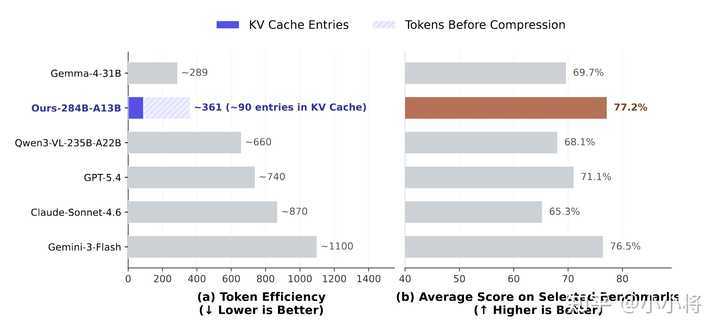

葛优:我拼命想看见哪怕一丝的光亮 DeepSeek 终于能「看见」了。不仅如此,它让自己拥有视觉能力的方法,也颇为有趣。 今天,你打开地图 App,可以轻松定位到一栋楼、一个景点、一家商铺。然后你把这个点发给朋友――你什么都不用解释,他可以直接导航到这里。 整个过程在你拇指下三秒钟完成。你几乎不会意识到,这三秒钟里你干了一件极其复杂的事:把一段模糊的自然语言意图――就那个商场南门――翻译成了一对精确的经纬度坐标。 当代地图引擎能做到这一点,是因为这件事被限定在了一个极度结构化的系统里。GPS 信号、路网数据、语义标记、POI 数据库,所有东西各司其职,坐标就是它们的本命。 但你想让一个多模态大模型做到这一点,就没那么简单了。你给它一张商场周边的街景图,说「指给我南门在哪里」。它能描述南门附近的样子,能告诉你附近有什么店,但它几乎不可能稳定地、可复现地给你一个准确的坐标。 差别在于,地图 App 的世界是「坐标原生」的。模型的世界是「语言原生」的。而语言,并不擅长干精确定位这件事。 DeepSeek 最近放出的自家首个「多模态模型」的技术报告,把这种失能起了个名字:指代鸿沟(Reference Gap)。它的核心判断很简单:多模态模型已经能看见了,但在推理中需要反复指向图像里的特定位置时,还不能稳定做到。而他们提出的做法,本质上就是给模型装一颗图钉――不是用来导航,而是用来思考。 一、一个被像素遮蔽的真相 过去两年,多模态模型的主要叙事是「分辨率竞赛」。从 224×224 到 1344×1344,从单张图到多裁剪,主流路线试图用一个朴素逻辑解决问题:看得越细,理解就越好。这确实有用――小字能读清了,小物体能辨认了。 但这条路线始终面临一些看上去很基础的挑战:为什么模型能在 4K 画质下做 OCR,却在数 12 个橘子时反复出错? 答案藏在人类的行为里。你数一堆散落硬币时,会用手指一个个点过去;你看复杂地图时,会无意识地用指尖划过路线。这已经不是单纯的「看」了,而是在用身体建立临时的工作记忆――把连续空间中的位置,转化为可引用的锚点。 模型缺的,正是这个锚。它的视觉感知存在,但推理链条里没有坐标。于是每次用语言指代「左边那个」「红色旁边那个」,就成了一轮赌博。当推理步数增多,错误的累积概率接近必然。 这就是 Reference Gap 的核心:看见是像素解码,指代是推理控件。两者是不同层面的问题,但业界长期把它们混在一起,用更高的分辨率掩盖了更深层面的缺位。 二、框和点,换了角色 视觉定位不是新鲜事。传统的计算机视觉(CV)中,从 YOLO 到 DETR,检测模型输出的就是「框」。DeepSeek 可以说是把这种思想代入到了生成式大模型当中。 传统检测:「框」就是最终产出,任务到此结束。模型画完框,交出「一只狗」的定位,使命完成。 DeepSeek 的视觉大模型:框是中间态。模型画框不是交答案,而是给自己画草图。它先圈定候选对象,锁定原始感知,再基于这些框进行计数、比较、归纳。 这就像你做几何证明题时画的辅助线――不是给老师看的,是你自己思考的一部分。辅助线不对题目本身增添新信息,但它把模糊的空间关系翻译成了离散的操作单元。 论文把这种能力称为 视觉原语(Visual Primitives)。它区分但联通了两种视觉基元:边界框(Bounding box) 负责圈定对象,适合计数、属性绑定;坐标点(Point) 负责标记位置与轨迹,适合迷宫、路径追踪。两者并非语义标注,而是推理线程中的占位符。 这里有一个容易被忽略的微妙之处:点比框更原始。框隐含着对对象边界的某种判断,而点几乎不携带这种语义包袱。它只回答一个问题:「现在在看哪里?」 这在连续追踪任务中反而更灵活――就像你用手指跟随地图上的河流,不需要知道河的宽度。 三、压缩比里的价值观 这篇文章还透露出一个贯彻始终的设计选择:极高的视觉压缩比。这和 DeepSeek 早前的 OCR 系列工作的思想一脉相承。 输入图像 756×756,经 ViT 编码后得到 2916 个 patch token。再经过 3×3 空间压缩和 CSA 压缩稀疏注意力,最终进入语言模型的视觉 KV 条目只剩下 81 个。这在一众动辄成百上千视觉 token 的模型中显得极为克制。 |

|

|

整体架构示意图:大幅压缩视觉 token 的同时,为后期的坐标化推理预留了计算空间。 模型的总注意力预算是有限的。你让视觉系统吃掉更多带宽,留给推理的空间就被挤占了。把视觉 token 压到极低,一方面降低了每步生成的计算成本,另一方面也让模型没有余地去反复「看」同一个区域――它被逼着靠坐标去锚定对象,而不是靠反复扫描图像去确认。 这不一定是对所有任务都更优的策略。高分辨率和多裁剪路线在密集文字、精细纹理场景里仍有不可替代的优势。但至少在这篇论文选择的战场――计数、路径、迷宫、空间关系――低视觉 token 配高精度坐标接口,效率上是自洽的。 四、推理链条,不是 Prompt 技巧 一个外行可能产生的疑问:让模型画框有什么难的?prompt 里加一句「请用坐标定位」不就行了? 格式上确实不难。难的是让模型在推理真正需要坐标的那一刻,自发地用出来,而不是等着 prompt 触发。 这中间的差距,隔着整套数据和后训练工程。论文披露的数字链条: 起点是 97,984 个 web grounding 数据源(grounding 这个术语指的是把一段文本指称精确绑定到图像中的某个区域,可以理解为一种「锚定」动作)经过语义过滤,保留 43,141 个;再经过几何质量过滤,保留 31,701 个;最终从中采样构造超过 4000 万高质量训练样本。 这套流程要同时满足三个条件:定位准、语义对、推理连贯。三者都是训练信号,但没有一个可以单独撑起整个目标。过去很少有 CoT 工作把空间坐标真正内化进思维链,很大一部分原因就是,这套数据工程的成本很高。 后训练阶段也分了层:先分别训 box 专家和 point 专家,各自做强化学习,再通过统一的 RFT 和 OPD(on-policy distillation,和DeepSeek-V4 是类似的方法论) 合进一个模型。 论文把计数、空间推理、迷宫和路径追踪四类任务称为冷启动(cold-start)。它们的共同点是:剥离复杂的开放语义,集中测试空间引用的稳定性。 之所以叫冷启动,是说它不是在现成模型上微调格式,而是从基础阶段就构建可验证的空间推理起步格式。 做完冷启动后,模型才被允许进入更开放的场景,用更开放的数据和 RL 扩展边界。 这是对泛化路径的一种判断:先从纯粹的空间指代学会「指」,再在语义丰富的世界里学「想」。先练草稿,再写文章。 |

|

|

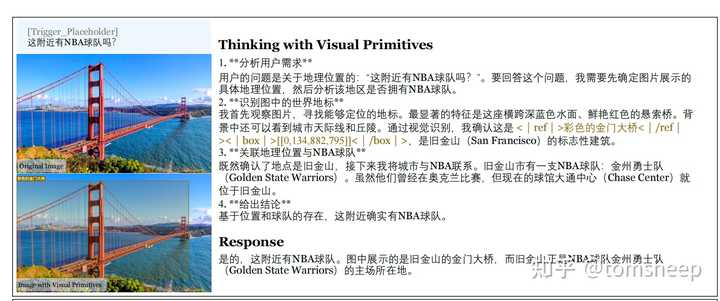

论文中展示的 Thinking with grounding 的案例之一五、实验数据解读 实验结果如何解读?论文给出了若干基准上的分数,包括公开的 CountQA、Pixmo-Count 等测试集,以及自建的计数、空间推理、迷宫导航与路径追踪任务等基准测试。注意作者对分数范围的审慎说明――仅覆盖研究重点维度,不代表整体能力。 |

|

|

在计数、空间推理、迷宫导航与路径追踪任务上与闭源 API 模型的对比。 如何解读这些数字呢?有三条原则: 第一,看重任务间的相对差异,而非单数绝对值。 在这张成绩单上,迷宫导航(66.9)和路径追踪(56.7)的绝对分数并不高,但已经遥遥领先了当前闭源前沿 API 模型。前沿闭源模型在路径追踪上的失败并不像「能力不足」,更像是「不知道该用什么工具」――它们在用语义推理硬解拓扑题,而不是用空间锚点追踪线条。 第二,警惕自建基准的分布亲和性。 论文自建的 DS_* 基准是为了系统探测 Reference Gap 而设计的。这意味着它们与被评测的模型能力定义高度对齐。这样问题定义清晰,变量控制严格。但也意味着,在这些基准上的优势不能直接等同于开放世界的泛化能力。 第三,问题定义的优先级高于排行榜。 目前最值得关注的不是它有没有在所有榜单上得第一,而是它在一个未被充分命名的失败模式上,提供了其他模型尚未系统构建的解法。如果这个判断成立,那么单个 benchmark 分数只是阶段性的注脚。 六、它没解决的事,可能比解决的更有趣 这篇技术报告也坦诚了一些局限,展开来看,比很多结论更有意味: 1. 分辨率仍然构成天花板。 对细粒度场景,视觉基元的精确度受限于输入分辨率。81 个 KV 条目的压缩比虽能大幅提升效率,但密集的小对象场景会让这个压缩比变成瓶颈。论文在原图小物体定位精度上的保守表述,暗示这不是一个可以无限压缩的方案。 2. 显式触发依赖。 当前能力很大程度上依赖locate、mark这类触发词。模型尚不能完全自己判断「这个任务该画框了」。它现在更像一个被训练出来的专项技能,而不是一种内化的推理策略。 3. 拓扑推理的泛化有限。 基于点的(point-based) 拓扑推理在跨场景上的泛化边界尚不清晰。迷宫和路径追踪设定干净可控,但真实世界里的拓扑推理――建筑内寻路、电路图追踪、河道走向判断――噪声和复杂度完全是另一个量级。 4. 因果归因悬而未决。 性能增益到底从哪里来?是坐标化思考这个接口设计本身,还是 4000 万高质量样本、精调的 RL、升级的基座能力共同作用的结果?从目前披露的材料里还拆不开。缺的对照实验包括:只去掉点/框格式、只增加视觉 token、仅留 SFT 不做 RL、用外部检测器替换内部视觉原语(visual primitives)。这些消融做齐之前,谁都没法说死收益是从哪个环节来的。如果收益主要来自数据和 RL,那同行复现的门槛会低一些;如果关键变量是坐标化推理接口本身,那它就更接近架构主张,而不只是后训练工程。 七、尾声 这个工作的核心朴素直接:视觉推理的中间态不能只有语言,必须包含空间坐标――因为语言天然不利于承载连续的空间关系,而大多数需要一步一步想的视觉任务,恰恰在考验这种承载能力。 最大的价值可能在于,用系统的工程和清晰的命名,把问题摆上了桌面:指代鸿沟(Reference Gap)。 从应用视角看,这个方向有自洽的想象空间。GUI Agent 需要知道按钮的坐标,文档理解需要知道表格的区域范围,医学影像辅助诊断需要圈出病灶位置,而不只是用一段话描述「右下象限异常」。坐标让推理变得可验证、可执行,而非仅仅是可信度浮动的一段描述。 这条路线仅仅还只是开始。坐标输出的稳定性和误差处理,与成熟检测器、分割器、OCR 工具链的成本收益比较,以及将 2D 的框/点映射到 3D 操作或机器人指令的中介层――都还有待进一步展开。 无论如何,我们都要恭喜 DeepSeek,终于迈出了跨越模态边界的第一步。 |

|

|

我又看见了,这是爱情的力量!拓展阅读DeepSeek-V4:大道之行也 送礼物 还没有人送礼物,鼓励一下作者吧 |

|

不是,啊?为什么要删技术报告? 这个和隔壁A社把自家claude code被动开源不是一个道理嘛? 你网上丢一下不就等价于谁都知道了啊?肯定有人留档的啊? |

|

|

但既然你都删了我先当作没有处理咯,到时候再看全文就是了。 目前确实DS有一个视觉的模型放那里官网给大家用了, 按照DS的过往特点,他家好像不太会有【为了商业目的】去做某个方向的决策。 在这方面有独特的研究突破的概率确实不小, 没准儿又打算弄点东西给OpenAI,A社,黄老板一个大惊喜…… |

|

|

送礼物 还没有人送礼物,鼓励一下作者吧 |

|

还没有等到灰度到我。 |

|

|

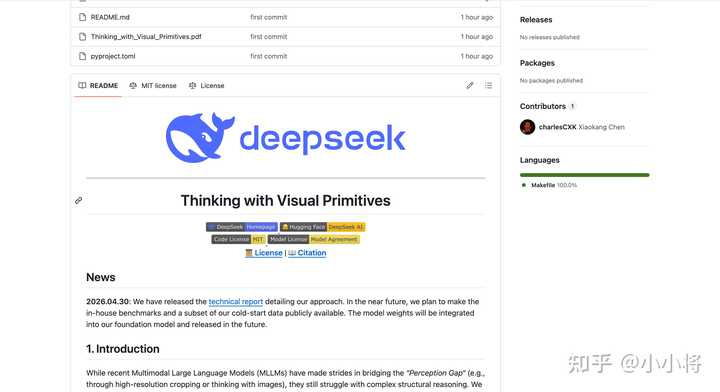

但是五一放假前官方已经发了这个多模态模型的技术报告https://github.com/deepseek-ai/Thinking-with-Visual-Primitives" data-tooltip-richtext="1" data-tooltip-preset="white" data-tooltip-classname="ztext-reference-tooltip">[1],不过刚刚看了一下,发现这个repo已经 404 了(可能是假期不想让大家太卷?)。 |

|

|

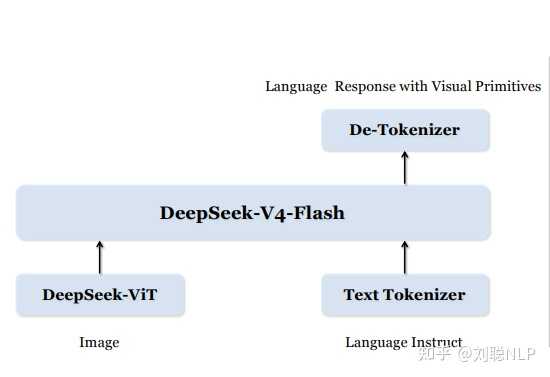

下面我们就来具体聊聊这个DeepSeek 的这个技术报告。 这个多模态模型是基于 DeepSeek-V4-Flash 架构构建的(总参数 284B,激活参数 13B),并引入了自研的 DeepSeek-ViT 作为视觉编码器。具体来看,它首先将输入图像按 14×14 的 patch 进行切分,生成对应的 patch tokens。随后在 ViT 输出阶段,又做了一步 3×3 的空间 token 压缩――也就是将每 9 个相邻的 patch token 在通道维度上压缩为 1 个 token。在此基础上,结合 DeepSeek-V4 中的 Compressed Sparse Attention(CSA)机制,这些视觉 token 在进入 Key-Value 缓存后还会被进一步压缩 4 倍。 |

|

|

举个例子:一张 756×756 的图像,先被切成 2916 个 patch token,再通过 3×3 压缩大幅减少 token 数量,最后结合 CSA 机制,在 KV cache 中只保留约 81 个视觉 token。整体从原始像素(共 571536 像素)到最终表示,实现了约 7056 倍的压缩。 尽管模型规模不算大、用的图像 token 也少得多,但在一些比较有挑战的计数和空间推理任务上,它的表现依然能和 GPT-5.4、Claude-Sonnet-4.6、Gemini-3-Flash 这些前沿模型打平。 |

|

|

|

|

|

那这是如何做到的呢?主要就是在于 DeepSeek 团队提出了一种新的视觉思考范式:用视觉原语进行思考(Thinking with Visual Primitives)。那什么是“视觉原语“呢?简单说,就是把点坐标和边界框当成思考的最小单位。模型在推理过程中可以输出标记点的位置或框出物体,这就像人类用手指着东西思考一样,把抽象思维锚定在具体坐标上。下面的这个例子很形象地说明了这种思考过程: |

|

|

这种思考范式和现在主流的“纯文字思维链”不太一样:只靠自然语言,其实很容易“说不清位置”。像数人头、走迷宫这类任务,单用文字描述空间关系,很容易越说越乱。DeepSeek 的思路更直接:与其让模型去“描述在哪”,不如让它直接“指出来”。 为了实现这种思考能力,DeepSeek 他们在预训练和后训练都下了很大的功夫: 预训练:海量清洗网络数据,只保留高质量边界框。用两阶段流水线过滤掉机器码、私有人称、严重裁切等脏数据。后训练:搞了个“专家分支”策略,专门训练“用框思考”和“用点思考”两个专家,最后再合并蒸馏成一个统一模型。 这里我觉得值得学习的是模型的后训练流程,这个流程与DeepSeek-V4大致类似,就是先生产专家模型,然后再蒸馏成一个统一模型。整个流程如下所示: |

|

|

DeepSeek-V4-Pro 直接画的 专家模型有两个,分别是“以框思考”和“以点思考”的专家模型,每个专家模型都需要 SFT 和 RL 。SFT 阶段会精心构造了少量但极其精准的冷启动数据集(覆盖计数、空间推理与通用VQA、迷宫导航、路径追踪任务)。下面一些具体的例子: |

|

|

计数 |

|

|

空间推理 SFT 过程除了使用这30%的冷启动数据,还会混合70%的通用多模态和纯文本数据。SFT 之后,会通过 RL 来进一步提升,这里采用 GRPO 算法,且设计了多个奖励模型,从三个维度给模型打分: |

|

|

得到专家模型之后,会通过RFT(拒绝采样微调)和OPD来蒸馏成一个模型。 RFT阶段的目标是将两个专家模型的能力初步融合进一个模型里: 数据生成:使用性能更强的专家模型,在一个更大的数据池上进行推理采样,生成高质量的“思维链+答案”数据。数据筛选:同样筛选出能提供学习信号的“中等难度”样本,并混合少量“简单”样本以防止模型遗忘。模型训练:从一个基础预训练模型(而不是从SFT模型)开始,用这个融合后的、更丰富的数据集进行微调,最终得到一个统一的模型。 尽管RFT之后的模型已经不错了,但其在特定任务上的能力与各自领域的专家模型仍有差距。接下来的OPD的目标就是弥补这个差距,实现方式和 DeepSeek-V4 一样采用全词汇表Logit蒸馏,具体的损失函数如下: \mathcal{L}_{\mathrm{OPD}}(\theta) = \sum_{i = 1}^{N}w_{i}\cdot D_{\mathrm{KL}}(\pi_{\theta}\parallel \pi_{E_{i}}) 其中, \pi_{\theta} 是学生模型, \pi_{E_{i}} 是老师模型, D_{\mathrm{KL}} 是反向KL散度,用于衡量两个模型输出概率分布的差异。通过最小化这个损失,学生模型在自己生成的推理路径上,学会了像不同老师那样思考,最终将两个专家的能力内化到一个统一的模型中。 感觉DeepSeek已经把这种“先专后统”的后训练流程玩的很溜了。 最后想说的是,DeepSeek 提出的这种新的“视觉思考”范式,大概率很快就会被业内跟进,成为一个新的共识方向。 参考^https://github.com/deepseek-ai/Thinking-with-Visual-Primitives 送礼物 还没有人送礼物,鼓励一下作者吧 |

|

没赶上报告,github 就下架了。 但找好了Hugging Face 文档链接。 需要的自取。 |

|

|

| [收藏本文] 【下载本文】 |

| 上一篇文章 查看所有文章 |

|

|

|

|

娱乐生活:

电影票房

娱乐圈

娱乐

弱智

火研

中华城市

印度

仙家

六爻

佛门

风水

古钱币交流专用

钓鱼

双色球

航空母舰

网球

乒乓球

中国女排

足球

nba

中超

跑步

象棋

体操

戒色

上海男科

80后

足球: 曼城 利物浦队 托特纳姆热刺 皇家马德里 尤文图斯 罗马 拉齐奥 米兰 里昂 巴黎圣日尔曼 曼联 |

| 网站联系: qq:121756557 email:121756557@qq.com 知识库 |